图像现在像语言一样被解析。OCR、视觉语境和像素级质量共同影响 AI 系统如何理解并呈现内容。

在过去十年中,图像 SEO 在很大程度上只是技术层面的基础维护:

-

压缩 JPEG,以应对没有耐心的访客。

-

为无障碍访问编写替代文本(alt text)。

-

实现延迟加载(lazy loading),以保持 LCP 指标处于良好水平。

尽管这些做法仍然是健康网站的基础,但像 ChatGPT、Gemini 这样的大型多模态模型的兴起,带来了新的可能性与挑战。

多模态搜索将不同类型的内容嵌入到同一个向量空间中。

我们现在优化的对象是“机器的凝视”。

生成式搜索通过将媒体内容切分为多个片段,并借助光学字符识别(OCR)从视觉信息中提取文本,使大多数内容变得对机器可读。

图像必须对机器之眼清晰可辨。

如果 AI 因为对比度过低而无法解析产品包装上的文字,或因分辨率不足而臆造细节,这就是一个严重的问题。

本文将拆解“机器的凝视”,把关注重点从加载速度转向机器可读性。

技术基础仍然很重要

在为机器理解进行优化之前,我们必须先尊重那位“守门人”:性能。

图像是一把双刃剑。

它们能够提升用户参与度,但往往也是布局不稳定和加载缓慢的主要原因。

“足够好”的标准早已不再局限于 WebP。

当资源加载完成后,真正的工作才刚刚开始。

为机器之眼而设计:像素级可读性

对于大型语言模型(LLM)而言,图像、音频和视频都是结构化数据的来源。

它们通过一种称为**视觉标记化(visual tokenization)**的过程,将图像拆分为由多个图块组成的网格,即视觉标记,把原始像素转换为一系列向量。

这种统一建模方式,使 AI 能够将“桌子上的一张[图像标记]图片”作为一个连贯的句子来理解和处理。

这些系统依赖 OCR 从视觉内容中直接提取文本。

正是在这里,质量开始成为一个排名因素。

如果图像经过严重的有损压缩,产生明显的压缩伪影,生成的视觉标记就会变得嘈杂。

分辨率过低会导致模型误解这些标记,从而产生幻觉——AI 会自信地描述实际上并不存在的物体或文字,只因为这些“视觉词语”不够清晰。

将 alt 文本重新框定为 grounding

对于大型语言模型而言,alt 文本承担了一种新的功能:grounding。

它充当语义路标,迫使模型消解模糊的视觉标记,从而帮助确认其对图像的理解。

正如 Zhang、Zhu 和 Tambe 所指出的:

“通过在相关的视觉图块附近插入文本标记,我们创建了语义路标,揭示了真实的、基于内容的跨模态注意力分数,从而引导模型。”

提示:通过描述图像的物理特征——光照、布局以及物体上的文字——你可以提供高质量的训练数据,帮助机器之眼将视觉标记与文本标记建立对应关系。

OCR 失败点审计

像 Google Lens 和 Gemini 这样的搜索代理使用 OCR 直接从图像中读取配料、说明和产品特性。

随后,它们可以回答复杂的用户查询。

因此,图像 SEO 现在已经延伸到了实体包装层面。

现行的标注法规——FDA 21 CFR 101.2 和欧盟 1169/2011——允许在紧凑型包装上使用小至 4.5–6 pt(约 0.9 mm)的字号。

“对于最大表面积小于 80 cm² 的包装或容器,第 2 款所述字体的 x 高度应等于或大于 0.9 mm。”

这虽然满足了人眼的阅读需求,却无法满足机器的凝视。

OCR 可读文本所需的最低像素分辨率要高得多。

字符高度至少应达到 30 像素。

对比度同样是一个问题,对比度应达到 40 个灰度值。

还需警惕风格化字体,它们可能导致 OCR 系统将小写字母 “l” 误识为 “1”,或将 “b” 误识为 “8”。

除了对比度之外,反光表面也会带来额外问题。

光面包装会反射光线,产生眩光,从而遮挡文字。

包装应被视为一种机器可读性特性。

如果 AI 因为眩光或手写体字体而无法解析包装照片,它可能会产生幻觉信息,或者更糟的是,直接忽略该产品。

原创性作为经验与投入程度的替代指标

原创性常被视为一种主观的创意特质,但它其实可以被量化为一个可衡量的数据点。

原创图像充当着规范性信号(canonical signal)。

Google Cloud Vision API 提供了一项名为 WebDetection 的功能,它会返回 fullMatchingImages(在全网发现的完全重复图像)以及 pagesWithMatchingImages(包含匹配图像的页面)。

如果你的 URL 对一组独特的视觉标记(例如某个特定的产品拍摄角度)拥有最早的索引时间,Google 会将你的页面视为该视觉信息的源头,从而提升其“经验(experience)”评分。

共现性审计

AI 会识别图像中的每一个物体,并利用它们之间的关系来推断品牌属性、价格区间以及目标受众。

这使得产品邻接性成为一种排名信号。要评估这一点,你需要审计你的视觉实体。

你可以使用诸如 Google Vision API 之类的工具来进行测试。

如果要对整个媒体资源库进行系统化审计,则需要使用 OBJECT_LOCALIZATION 功能拉取原始的 JSON 数据。

该 API 会返回诸如“手表”“塑料袋”“一次性杯子”等物体标签。

Google 提供了一个示例,其中 API 会针对图像中的物体返回如下信息:

| Name | mid | Score | Bounds |

| Bicycle wheel | /m/01bqk0 | 0.89648587 | (0.32076266, 0.78941387), (0.43812272, 0.78941387), (0.43812272, 0.97331065), (0.32076266, 0.97331065) |

| Bicycle | /m/0199g | 0.886761 | (0.312, 0.6616471), (0.638353, 0.6616471), (0.638353, 0.9705882), (0.312, 0.9705882) |

| Bicycle wheel | /m/01bqk0 | 0.6345275 | (0.5125398, 0.760708), (0.6256646, 0.760708), (0.6256646, 0.94601655), (0.5125398, 0.94601655) |

补充说明:mid 是一个机器生成的标识符(MID),对应于该标签在 Google 知识图谱中的条目。

API 本身并不知道这些语境是正面的还是负面的。

你才是判断者,因此需要检查这些视觉邻居是否与你的定价所传达的故事保持一致。

通过将一只蓝色皮革手表与复古黄铜指南针以及温暖的木纹表面一同拍摄,Lord Leathercraft 精心构建了一种明确的语义信号:传承式探索。

模拟机械、陈旧金属与可触感麂皮的共现,推断出一种永恒冒险与旧世界精致感的人物画像。

如果将同一只手表与霓虹色能量饮料和塑料数字秒表放在一起拍摄,叙事就会因不协调而发生转变。

此时,视觉语境传达的是大众市场的实用性信号,从而稀释了该实体的感知价值。

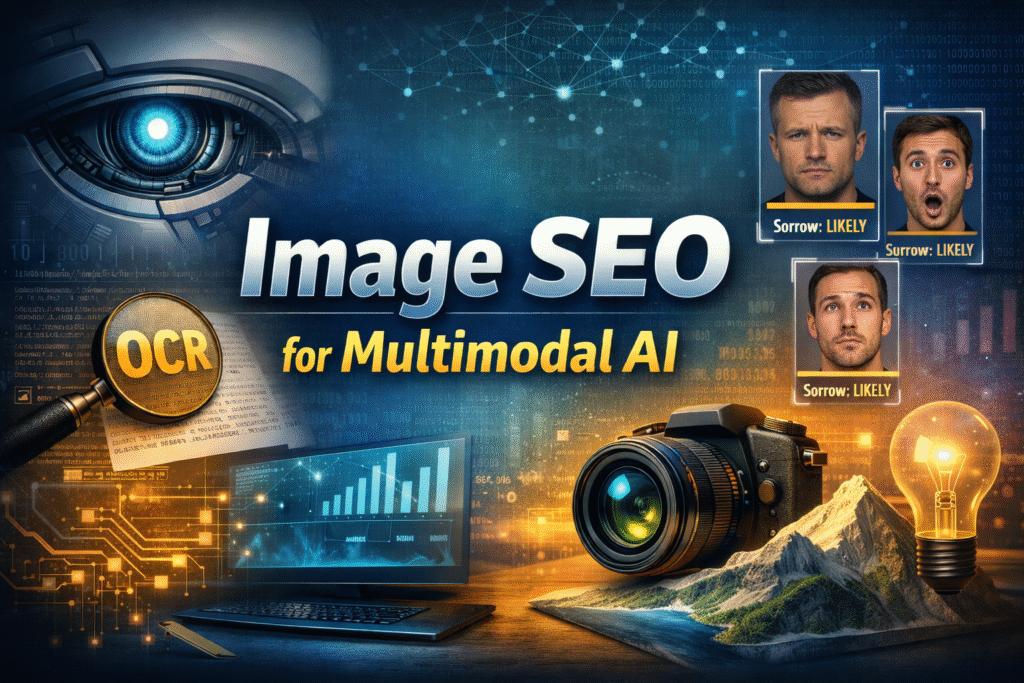

量化情感共鸣

除了识别物体之外,这些模型在解读情绪方面也越来越擅长。

诸如 Google Cloud Vision 之类的 API,可以通过为人脸中检测到的“喜悦”“悲伤”“惊讶”等情绪分配置信度分数,来量化情感属性。

这由此引入了一个新的优化维度:情绪对齐。

如果你销售的是充满乐趣的夏日服装,但模特呈现出的情绪却是阴郁或中性——这在高级时尚摄影中很常见——那么 AI 可能会因为视觉情绪与搜索意图相冲突,而降低该图像在相关查询中的优先级。

如果不写代码、只做快速检查,可以使用 Google Cloud Vision 的在线拖拽演示工具,查看四种主要情绪:喜悦、悲伤、愤怒和惊讶。

对于诸如“快乐的家庭晚餐”这样的正向搜索意图,你希望 joy(喜悦) 属性被判定为 VERY_LIKELY。

如果结果显示为 POSSIBLE 或 UNLIKELY,那么这个信号对于机器来说过于微弱,无法自信地将该图像索引为“快乐”。

若要进行更严格的审计:

-

将一批图像送入 API 进行处理。

-

通过发送 FACE_DETECTION 功能请求,重点查看 JSON 响应中的 faceAnnotations 对象。

-

检查其中的 likelihood 字段。

API 会以枚举值或固定类别的形式返回这些结果。

以下示例直接来自官方文档:

“rollAngle”: 1.5912293,

“panAngle”: -22.01964,

“tiltAngle”: -1.4997566,

“detectionConfidence”: 0.9310801,

“landmarkingConfidence”: 0.5775582,

“joyLikelihood”: “VERY_LIKELY”,

“sorrowLikelihood”: “VERY_UNLIKELY”,

“angerLikelihood”: “VERY_UNLIKELY”,

“surpriseLikelihood”: “VERY_UNLIKELY”,

“underExposedLikelihood”: “VERY_UNLIKELY”,

“blurredLikelihood”: “VERY_UNLIKELY”,

“headwearLikelihood”: “POSSIBLE”

该 API 使用一套固定尺度对情绪进行评分。

目标是将核心图像在目标情绪上的判定,从 POSSIBLE 提升至 LIKELY 或 VERY_LIKELY。

情绪等级说明如下:

-

UNKNOWN(数据缺失)

-

VERY_UNLIKELY(强烈负向信号)

-

UNLIKELY

-

POSSIBLE(中性或模糊)

-

LIKELY

-

VERY_LIKELY(强烈正向信号——应以此为目标)

使用这些基准

如果机器几乎看不清人脸,就无法优化情感共鸣。

如果 detectionConfidence 低于 0.60,说明 AI 在识别人脸时遇到了困难。

因此,任何基于该人脸得出的情绪判断,在统计意义上都只是噪声,缺乏可靠性。

0.90+(理想):高清、正面、光线良好。AI 非常确定,可以信任情绪评分。0.70–0.89(可接受):适用于背景人脸或次要的生活方式场景照片。< 0.60(失败):人脸可能过小、模糊、侧脸、或被阴影/太阳镜遮挡。

虽然 Google 的官方文档并未给出上述具体指导,微软对其 Azure AI Face 服务的访问也较为有限,但 Amazon Rekognition 的文档指出:

“在某些情况下,较低的阈值(例如 80%)也可能足以用于识别照片中的家庭成员。

弥合像素与意义之间的语义鸿沟

以与核心内容同等的编辑严谨性和战略意图来对待视觉资产。

图像与文本之间的语义鸿沟正在消失。

图像正作为语言序列的一部分被处理。

像素本身的质量、清晰度和语义准确性,如今与页面上的关键词同样重要。